ByeType vs Typeless vs Wispr Flow — 用 Claude Code 7天打造 AI 語音工具

Wei-Ren Lan

現有手機/筆電的語音輸入法還沒有到很智慧,很多時候辨識錯誤專業術語/無法因應情境智慧化。 這2~3年,基於AI 語音辨識/LLM技術的成熟,開始有許多廠商在將這些技術延伸到語音輸入的強化。 雖然這一兩年Apple已開始推出Apple Intelligence,可以在算力足夠的裝置推進行即時語音辨識/LLM處理。 但系統配置的語音輸入法,還是沒讓使用者滿意。 . 不過即使3年前ChatGPT已經推出,有人跟我說一個只對AI算法/應用以及Python熟悉的工程師 能在一週內用Swift做出一個AI語音鍵盤App? 我是絕對無法相信

但在2026/02/22離Claude Code 2025/02/24推出不到一年。 我在2026的Lunar Year 7天假期完成這項可能性實驗。

感謝Transformer/LLM/Agentic Engineering帶來的知識豐盛

目錄

- 成果

- 投入

- 為什麼開始?

- 競品Survey

- 技術簡介

- Agentic Engineering

- 結語

成果

- 一個基於Swift的ios 客製化鍵盤app,同時具備以下功能

- 即時語音辨識+場景風格潤飾

- 專業術語修正

- 語音指令修正文字:透過語音述說,修改辨識後的文字

- 可以自定義風格的prompt

- 支援本地Whisperkit模型+雲端Vendor(OpenAI/Anthropic/Gemini/Elevenlabs)

- 一個部署於Cloudflare Plages的Landing Page https://byetype.com/

- 架設於Claudeflare Pages

- 多國語系

- 主頁/功能頁/隱私權頁面

投入

- 一個AI音訊應用7年多經驗的工程師7天

- 大學EE/碩班生醫電資,熟悉工程/Debug

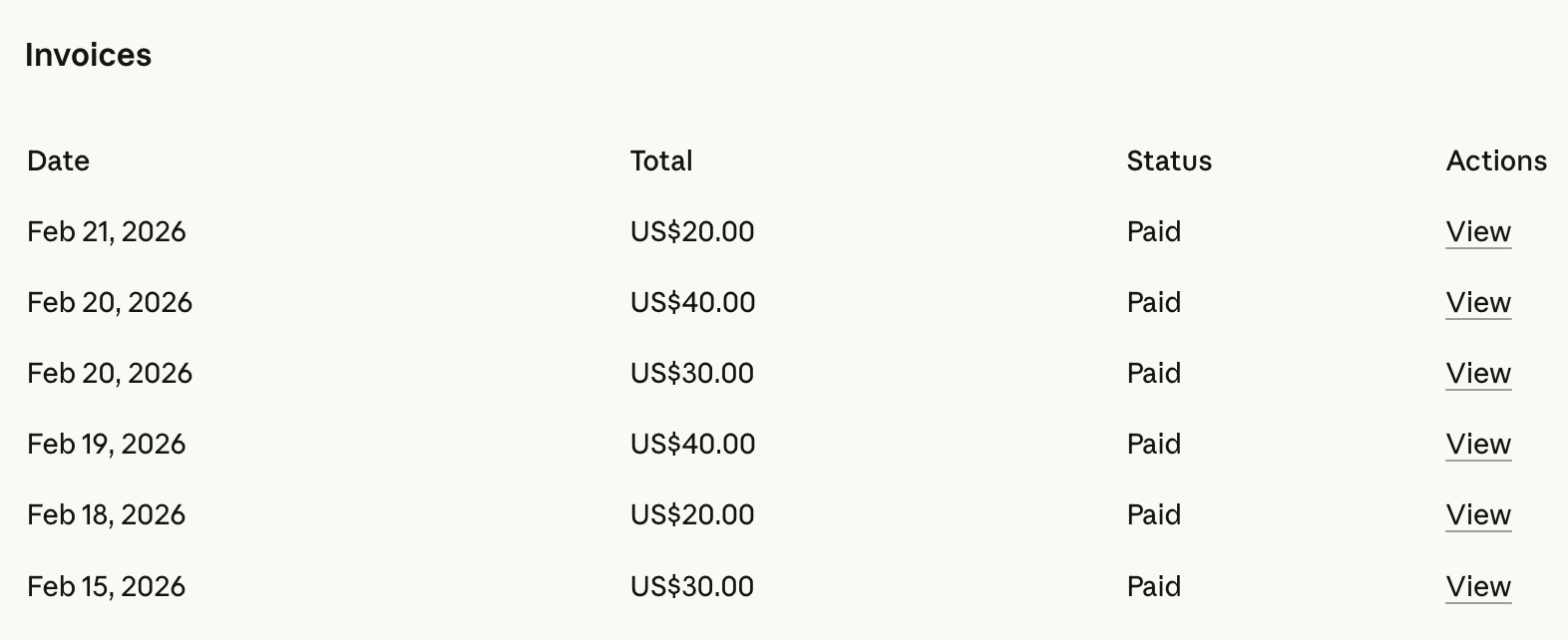

- Claude Max: US$100

- Claude Code Extra Usage: US$230

為什麼開始?

在2026年2月10日有日本團隊於社群X(以前是Twitter)分享近期於亞洲還蠻風行的AI Dictation工具Typeless 針對 Typeless 進行逆向與網路/本機資料分析,指出其語音辨識為雲端處理,且可能伴隨蒐集完整 URL、前景 App/視窗標題、螢幕可見文字、剪貼簿與系統層級鍵盤事件等情境資料;另外,本機 DB 可能以明文保存轉錄內容與瀏覽資訊,與「Zero data retention」的行銷說法存在落差。當高敏感權限(Accessibility/螢幕錄影等)與營運透明度不足同時存在時,整體風險會被放大,使用者需特別留意資料流向與權限授予範圍。

基於多年AI應用產品的經驗,大概能猜到AI Dictation工具的機制。 例如: 語音辨識後獲得逐字稿,同時獲得使用者當下的App場景,再將逐字稿與App場景資訊作為提示詞給LLM進行格式處理

研究了一輪,市場上開源暫時還沒有IOS方案。 很好奇實際做起來會如何,因此開始實作。

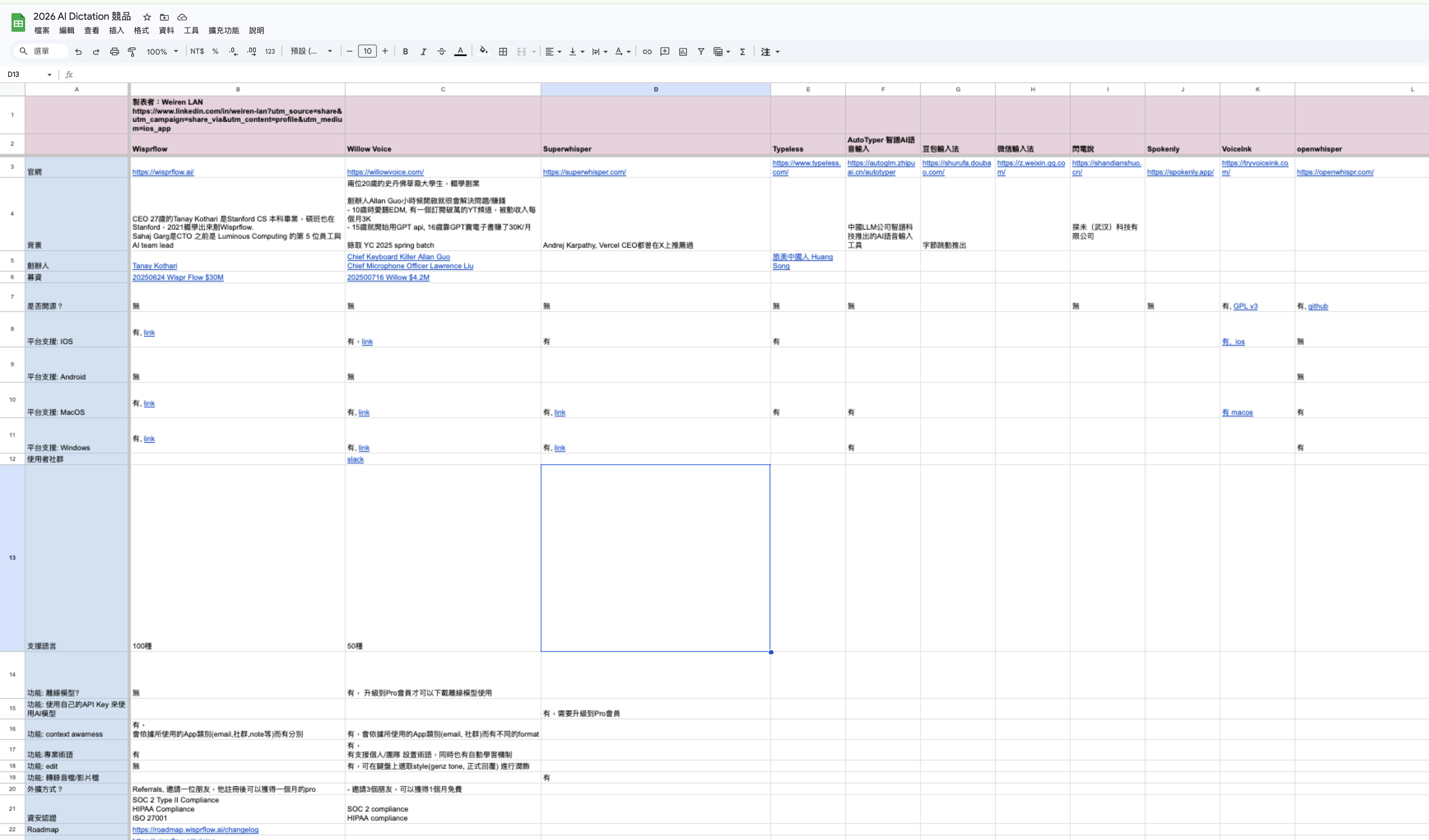

競品Survey

在2026年2月,這個市場已經很競爭 市場上在第一線市場(美國)已有強勁的產品服務WisprFlow/Willow,他們分別在2025募到了$US30M/ $4.2M。 在2025年AI大神 Andrej Karpathy 一詞Vibe Coding襲捲開發者圈時,語音輸入成了Vibe Coding的標準配備。當時他也推了另一間服務SuperWhisper

這兩個團隊都很年經,WisprFlow創辦人年僅27歲,Willow的兩位創辦人分別是20歲並從Stanford輟學。

我很喜歡Willow團隊的生命力,創辦人Allan Guo小時候開啟就很會解決問題/賺錢,10歲時愛聽EDM, 有一個訂閱破萬的YT頻道,被動收入每個月3K,15歲就開始用GPT api, 16歲靠GPT賣電子書賺了30K/月。而他們給自己的Title很有趣Chief Keyboard Killer & Chief Microphone Officer

而中國境內很多大模型公司也都有推出AI語音輸入

- 智譜: AutoTyper 智譜AI語音輸入

- 字節跳動: 豆包語音輸入法

亞洲熟悉的Typeless其實是後進,由留美的中國人於2025年底推出,主切中國外東亞市場。

除了上面提及比較有大資本公司提供的服務,也有不少小開發者跟提供桌面版(macos/windows)並講求地端模型的開源方案,如Handy, OpenWhisper

大家功能其實差不多: (1)準確率高的語音轉文字 (2)LLM格式調整 (3)專業術語修正 由於技術基礎雷同,導致細微重要的差異, 來自體驗設計,如品牌意象/介面特色/操作難易度/辨識速度以及使用流程的安排。

而現階段服務壁壘,來自誰能搶到使用者心理認知並讓人信任。也因此如Wisprflow/Willow去符合了ISO27001,SOC2 Type II, HIPAA

若有興趣,可以查看我整理的AI Dictation競品整理(繁體中文)

- https://docs.google.com/spreadsheets/d/17x49TAXIoL1Tyz9yl2S15w21hw25E8jqBhTXRqOLAao/edit?usp=sharing

總結

- 技術成熟/功能差異不大,白熱化產品賽道

- 使用者經驗/如何觸及使用者成為關鍵

- 系統如IOS也開始支援Edge端辨識

技術簡介

AI Dictation的技術核心 (1)語音辨識模型 (2)LLM

流程: a. 使用者按下客製化鍵盤觸發錄音 b. 將音檔送給語音辨識模型 c. 透過系統api,獲得使用者正輸入App類別(mail,note,search),了解當下場景 d. 將語音辨識逐字稿,以及對應使用者場景所需格式prompt,給予LLM來修飾

而這流程的要求主要有兩個 a. 準確率高 b. 完成時間快

這邊我們可以透過benchmark網站來查詢適合的Vendor https://artificialanalysis.ai/

額外的部份是 c. 隱私

目前ios端可以用的是Argmax優化過的WhisperKit

Agentic Engineering

純粹從無到有讓Claude Code開始,會是很有挑戰的事情。 即使Claude Code已內建Plan mode,但仍是不足支撐複雜架構的實踐。 也因此我們需要準備可用的工具/workflow讓Claude Code參考。

Context

-

基礎Context: 關於基礎功能/架構的參考

- 目標設定: 基於swift來撰寫ios版的ai dictation功能

- 參考架構準備

- 鎖定桌面版(macos/windows)並以typescript撰寫的開源AI dictation工具openwhisper

- Whisperkit的使用範例: https://github.com/argmaxinc/WhisperKit

- 各家AI Vendor的API文件頁面url/ github sample code

-

AI Dictation各家截圖:Onboarding/首頁/設定頁/客製化鍵盤頁面

Tool準備

- Skills for Claude Code

- ui-ux-pro-max-skill: 基於此skill來評估/優化介面的設計,調整使用體驗。

- compound-engineering-plan: 來自Every.to 團隊推出的軟體工程workflow skill,從plan/review/work都有涵蓋。

- MCP

- Context7: 獲取相關依賴,library的文件。

其他

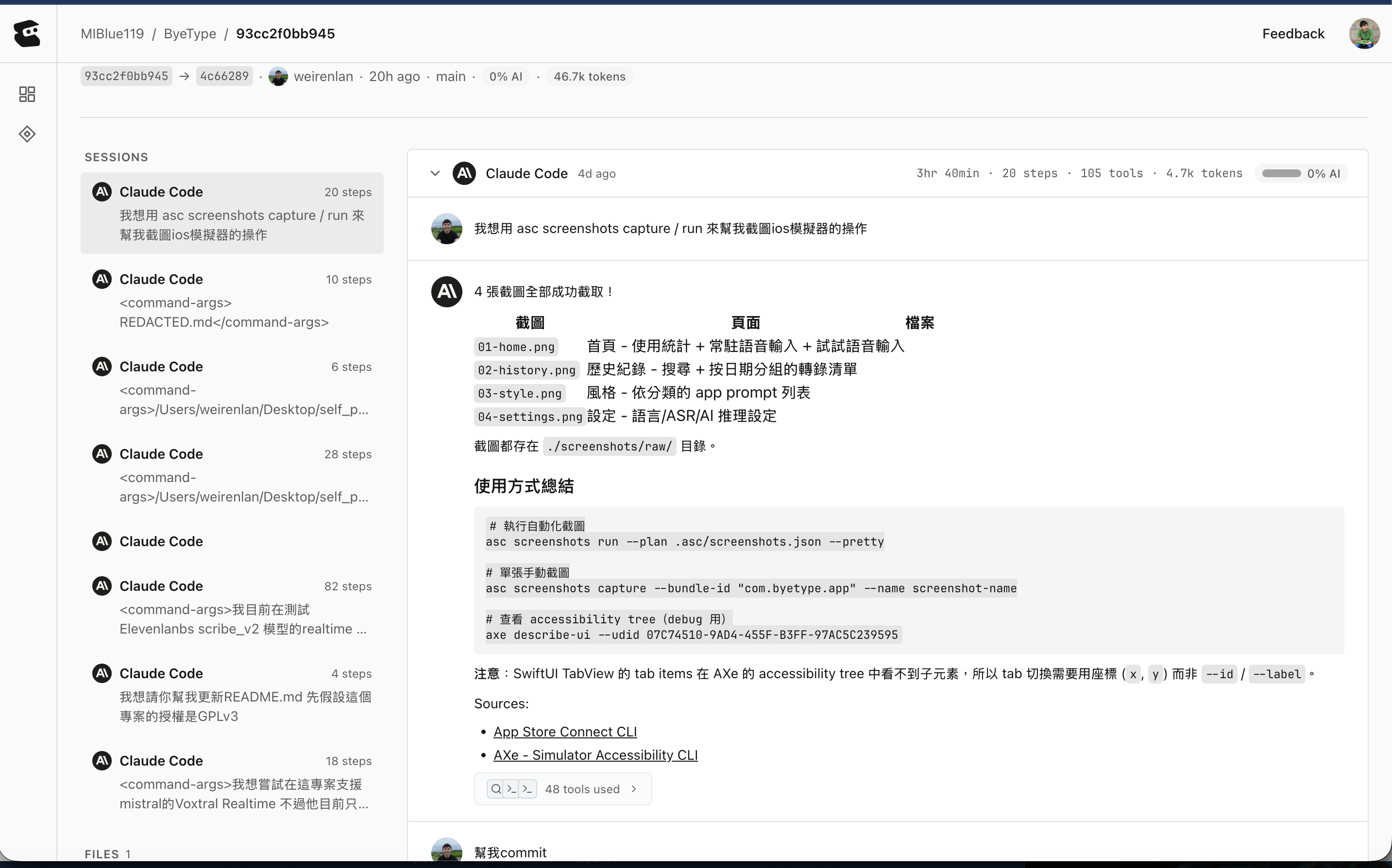

- Entire: Github 前CEO Thomas 捧著創投塞給他的種子輪6000萬美金來切入解決這問題,創立了新服務entire.io,他會記錄什麼? a. 該次git commit的coding agent session對話內容 b. 燒了多少token c. 花了多少時間 d. 執行多少步驟 操作很方便,跟著github上的指令在repo中執行,就能讓entire跟著git commit連動

-

Github action: 來做基本的CI/CD

-

AppStore App-Store-Connect-CL: 自動化跑AppStore相關流程,同時還可以用來自動化截圖。可以搭配Claude Code來『請幫我在simulator 使用asc screenshots 截圖』

-

Codex: 板凳球員,Claude Code token limit達到時,來上位做比較初級的任務

-

ChatGPT: 透過Web Search/DeepResearch來基本背景資訊搜尋,了解AppStore上架流程/Oauth設計等

基礎環境

- Xcode: 負責App編譯與部署

- Iphone: 用來測試App

- Github: 進行CI/CD以及code base版本控管

- Apple Developer: 需購買developer會員以便進行App發佈

- Cloudflare pages/domain: 作為landing page的部署環境

施工流程

- Compound Engineering Plan 規劃feature/feature test,此步驟會輸出markdown plan供人review

- Compound Engineering Review feature

- Compound Engineering Implement

- /ui-ux-pro-max-skill 進行ui/ux優化

- 真人測試

- feature測試ok後,跑git commit觸發CI/CD

使用模型

- 首選Opus 4.6,相比Sonnet還是能在長時間處理過程中維持資訊搜集/規劃/實作的一致性。

坑

-

App 功能的State Management: 在這塊Agentic Coding會有遺漏。主架構流程還是需要人清楚的用自然語言描述。 否則很容易觸發loop,或是你以為結束了,但下一次開啟辨識完的結果又出現

-

音訊處理知識 還是需要理解音訊取樣率/格式差異,由於asr vendor有支援的取樣率/格式限制。

-

新功能加入後的影響 在實作單一功能時,可能無法顧及全面的流程。仍需要留意新功能加入後,已實作的feature是否仍正常。

結語

在這個為期7天的年假黑客松是神奇的體驗。 可以感受Agentic Coding對能力的增幅,像進入精神時光屋能讓工程師快速切入不熟悉的語法。 而Claude Code輸出帶來的多巴安,讓我像是受制的動物,期待他每一次的產出。 過往累積的軟體工程經驗/流程仍然很重要,可以讓你穩定的向前,遇到Bug時能快速的理清可能原因。 但能理解進階的優化與功能,如記憶體使用量/UI/UX設計,以及會員系統與金流綁定,仍然需要該領域深耕多年的專業輔助。

祝大家也能Happy Agentic Coding

我是Weiren,一位AI 7 年以上 AI 系統開發經驗,專注於語音辨識、音訊智慧與裝置端機器學習。 歡迎交流 https://www.linkedin.com/in/weiren-lan/

Wei-Ren Lan

7 年以上 AI 系統開發經驗,專注於語音辨識、音訊智慧與裝置端機器學習。參與多個 AI 專案,從 0 到 1 將 ASR、語音降噪、即時推論等技術落地到產品中。ByeType 結合了我在語音技術上的多年實戰,為你打造真正好用的語音輸入工具。